NVIDIA GTC 2026 완전 정리 — Jensen Huang 키노트·새 AI 칩·핵심 발표 총정리¶

실무자 관점에서 본 Vera Rubin·Groq 추론칩·NemoClaw·N1X, 그리고 한국 반도체에 미치는 영향

Quick Info

| 항목 | 내용 |

|---|---|

| 일정 | 2026년 3월 16일(월) ~ 19일(목) |

| 키노트 | Jensen Huang CEO, 3/16 오전 11시 PT = 한국시간 3/17(화) 오전 3시 |

| 장소 | 미국 산호세 SAP Center + 온라인 무료 스트리밍 |

| 참가 규모 | 190개국, 약 3만~3만 9천 명 |

| 온라인 시청 | nvidia.com 및 YouTube 무료 스트리밍 |

핵심 3줄 요약

- Vera Rubin: Blackwell 대비 추론 5배, 토큰당 비용 1/10로 떨어지는 차세대 AI 슈퍼컴퓨터

- Groq 추론칩: 200억 달러 딜로 확보한 SRAM 기반 추론 전용 아키텍처, OpenAI가 첫 고객

- 한국 반도체: 삼성·SK하이닉스 HBM4 양강 체제 확립, SOCAMM2라는 새로운 시장까지 열림

GTC 2026, 왜 이번이 특별한가¶

GTC는 매년 열리지만, 매번 같은 무게감은 아니다.

2024년 GTC에서 Blackwell 아키텍처를 발표했을 때, NVIDIA 주가는 하루 만에 7.4% 급등했다. 그해 GTC는 “AI의 우드스탁”이라는 별명까지 얻었다. 반면 2025년은 트럼프 행정부의 관세 불확실성에 눌려 다소 조용한 해였다.

그런데 2026년, Jensen Huang이 한국경제신문 인터뷰에서 직접 이렇게 말했다. “세상이 한 번도 보지 못한 칩을 공개하겠다.” 30년 넘게 NVIDIA를 이끌어온 사람이 이런 표현을 쓸 때는 뭔가 근거가 있다.

이번 GTC가 특별한 이유는 단순히 새 칩이 나와서가 아니다. AI 산업 자체의 무게 중심이 이동하고 있기 때문이다. 지금까지의 AI 투자는 대부분 학습(Training)에 집중됐다. 대규모 모델을 만드는 데 돈을 쏟아부었다. 하지만 2026년부터는 이야기가 달라진다. Deloitte 분석에 따르면 2026년까지 추론(Inference)이 전체 AI 컴퓨트 지출의 2/3를 차지할 전망이다. 2023년에는 1/3에 불과했다.

쉽게 말하면, AI 모델을 만드는 것보다 만든 모델을 실제로 돌려서 서비스하는 비용이 훨씬 커지고 있다는 뜻이다. ChatGPT, 코드 어시스턴트, AI 에이전트 같은 실시간 서비스가 폭발적으로 늘어나면서, 추론 인프라에 대한 수요가 학습 인프라를 추월하기 시작한 것이다.

NVIDIA의 FY2026(2025년 2월~2026년 1월) 실적이 이를 뒷받침한다. 연간 매출 2,159억 달러(전년 대비 65% 증가), 시가총액 약 4.8조 달러. 데이터센터 매출만 1,973억 달러로 전체의 91.5%를 차지한다. AI가 사실상 NVIDIA 그 자체인 셈이다.

이런 배경에서 GTC 2026은 “추론 시대(Age of Inference)”의 공식적인 개막을 선언하는 자리가 될 가능성이 높다.

그렇다면 이번에 공개될 하드웨어는 구체적으로 어떤 것들인가?

Vera Rubin 플랫폼 — 차세대 AI 가속기의 모든 것¶

Rubin GPU 핵심 스펙¶

Vera Rubin은 현재 양산 중인 Blackwell Ultra(GB300)의 후속 플랫폼이다. “그냥 업그레이드”라고 보기엔 성능 격차가 크다.

GPU 하나에 3,360억 개의 트랜지스터가 들어간다. 리티클 다이 2개를 결합한 구성이다. 메모리는 HBM4 288GB, 22TB/s 대역폭을 탑재한다. 현행 Blackwell Ultra의 HBM3e 288GB, 8TB/s와 비교하면 대역폭만 2.75배 뛰었다.

성능 수치는 더 인상적이다:

| 지표 | Blackwell Ultra (GB300) | Vera Rubin | 배율 |

|---|---|---|---|

| GPU 메모리 | 288GB HBM3e | 288GB HBM4 | 동일 용량, 대역폭 2.75배 |

| 메모리 대역폭 | 8 TB/s | 22 TB/s | 2.75x |

| 추론 성능 (GPU당) | ~10 PFLOPS NVFP4 | 50 PFLOPS NVFP4 | 5x |

| 훈련 성능 (GPU당) | ~10 PFLOPS | 35 PFLOPS NVFP4 | 3.5x |

| NVL72 랙 추론 | 1.1 EFLOPS | 3.6 EFLOPS | 3.3x |

| NVL72 랙 훈련 | — | 2.5 EFLOPS | — |

| 토큰당 비용 | 기준 | 1/10 수준 | 10x 절감 |

NVL72 시스템은 72개의 Rubin GPU와 36개의 Vera CPU를 NVLink 6으로 연결한다. 스케일업 대역폭만 260TB/s다. 랙 하나가 HBM4 20.7TB + LPDDR5x 54TB를 품고 있다.

실무적으로 이게 무슨 의미냐면, 현재 Blackwell 클러스터에서 돌리는 추론 워크로드를 Vera Rubin으로 옮기면, 같은 성능을 내는 데 필요한 하드웨어가 대폭 줄어든다. 토큰당 비용이 1/10이라는 건, 지금 “비용 때문에 AI 도입을 망설이는” 기업들에게 결정적 전환점이 될 수 있다.

Vera CPU — Grace를 대체하는 커스텀 ARM 프로세서¶

Rubin GPU 옆에는 새로운 CPU가 들어간다. Vera CPU는 ARM “Olympus” 코어 기반으로 88코어, 176스레드를 제공한다. 트랜지스터 수 2,270억 개. CPU 메모리는 최대 1.5TB LPDDR5x (SOCAMM 기반), 1.2TB/s 대역폭이다.

기존 Grace CPU가 이미 좋은 평가를 받았지만, Vera는 에이전틱 AI 워크로드에 최적화된 설계를 적용했다. AI 에이전트가 다단계 추론과 도구 호출을 반복할 때 필요한 CPU 성능을 극대화한 것이다. CNBC 보도에 따르면 NVIDIA는 이번 GTC에서 CPU 전용 랙까지 발표할 가능성이 있다 — Jensen Huang이 말한 “세상이 한 번도 보지 못한 칩”이 이것일 수도 있다.

타이밍¶

Vera Rubin은 2026년 Q1에 풀 프로덕션에 들어갔다는 게 NVIDIA의 공식 발표다. 파트너에 대한 실질적 공급은 2026년 하반기부터다. 뒤를 이어 Rubin Ultra가 2027년 하반기, 차차세대 Feynman 아키텍처가 2028년 이후 예정되어 있다.

기존 Blackwell 인프라를 운영 중인 기업이라면, 즉시 필요한 워크로드는 현재 양산 중인 GB300으로 대응하고, 추론 중심 워크로드는 Vera Rubin을 기다리는 것이 합리적인 전략이다.

하지만 Rubin이 학습과 추론을 모두 커버하는 범용 GPU라면, NVIDIA가 추론 전용으로 준비한 비밀 무기가 따로 있다.

Groq 기술 기반 추론 전용 칩 — NVIDIA의 200억 달러 베팅¶

왜 NVIDIA가 200억 달러를 썼나¶

2025년 12월, NVIDIA는 Groq과 200억 달러 규모의 비독점 라이선싱 계약을 체결했다. Groq의 창업자 Jonathan Ross까지 합류시켰다. 반도체 업계에서 200억 달러는 가볍게 던지는 숫자가 아니다.

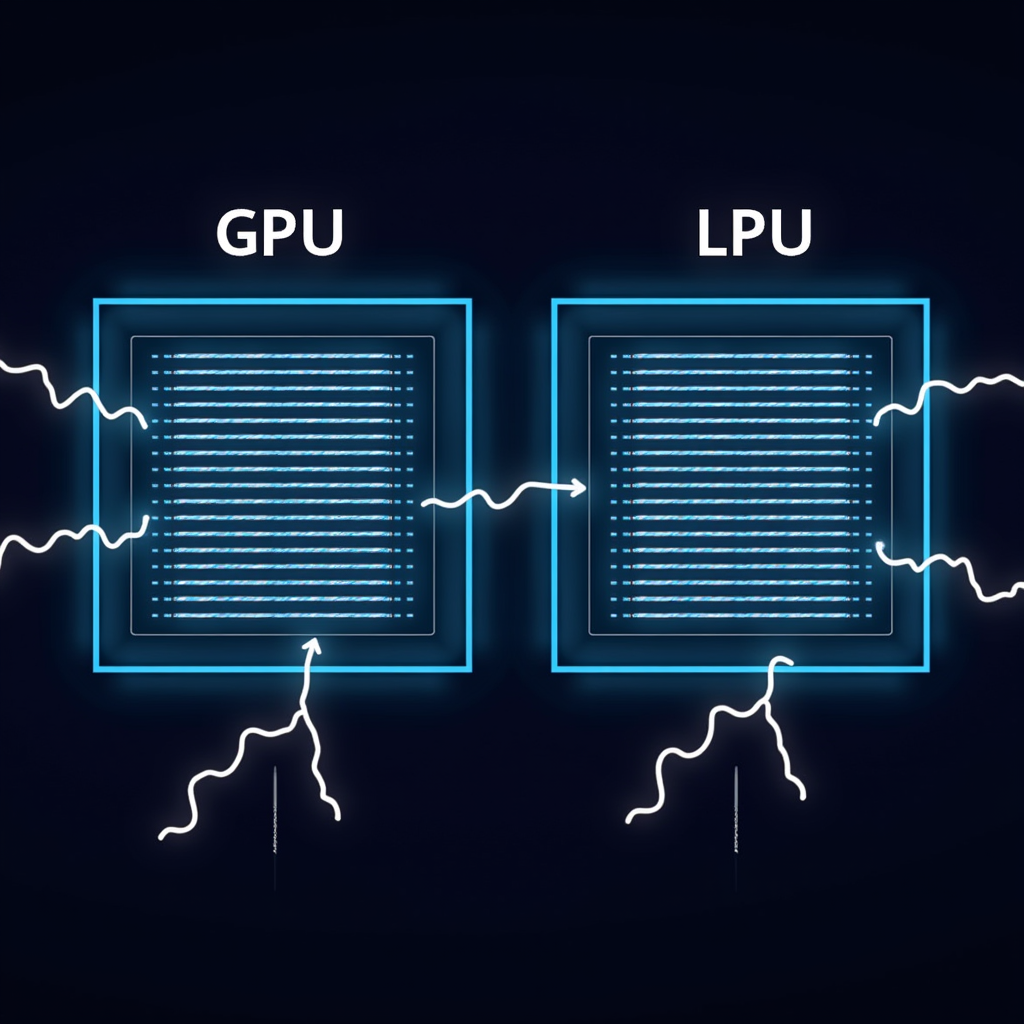

Groq의 LPU(Language Processing Unit)는 GPU와 근본적으로 다른 설계 철학을 가지고 있다. 핵심 차이는 이렇다:

- GPU: HBM(고대역폭 메모리) 기반, 병렬 처리에 최적화, 범용적

- LPU: 고속 SRAM 기반, 결정론적(deterministic) 아키텍처, 추론에 특화

결정론적 아키텍처라는 건 무엇이냐면, 입력이 들어오면 정확히 언제 출력이 나올지 예측할 수 있다는 뜻이다. GPU는 병렬 처리 특성상 레이턴시가 불규칙하지만, LPU는 매번 동일한 속도로 토큰을 뱉어낸다. 실시간 AI 서비스에서 이 차이는 크다.

독립 테스트 결과, Groq LPU는 기존 솔루션 대비 2배 빠른 추론 속도(500~1,000+ 토큰/초)를 보여줬다. NVIDIA가 이 기술을 Vera Rubin 플랫폼과 통합하면 토큰/초 10배 개선, 에너지 소비 90% 감소가 가능하다는 게 EE Times의 분석이다.

LPX 랙 — 추론 특화 인프라의 실체¶

GTC 2026에서는 Groq 기술 기반의 LPX 랙이 공개될 전망이다.

| 세대 | 사양 | 비고 |

|---|---|---|

| 1세대 LPX | 64 LPU (32 RealScale ASIC 타일) | 이미 발표됨 |

| 2세대 LPX | 256 LPU/랙, TSMC A16 공정, 3D 스태킹 | GTC 2026 발표 예상 |

2세대는 1세대 대비 4배 스케일업으로, 밀리초 단위 레이턴시의 실시간 추론이 가능하다. Jensen Huang이 말한 “세상이 한 번도 보지 못한 칩”의 유력 후보 중 하나가 바로 이 SRAM 기반 추론 전용 칩이다.

OpenAI가 첫 고객인 이유¶

OpenAI가 Groq LPX 인프라에 3GW 전용 용량을 확보했다는 보도가 있다. 3GW라는 숫자가 감이 안 올 수 있는데, 대형 원전 3기 수준의 전력이다. ChatGPT, 코드 어시스턴트, AI 에이전트 같은 실시간 서비스를 전 세계적으로 운영하려면 이 정도 규모의 추론 인프라가 필요하다는 얘기다.

실무 시사점 — GPU + LPU 하이브리드 시대¶

이제 AI 인프라 설계의 공식이 바뀐다.

- 학습(Training): Vera Rubin GPU

- 추론(Inference): LPX 랙 (Groq 기술 기반)

워크로드별로 최적의 하드웨어를 선택하는 하이브리드 아키텍처가 표준이 되어간다. VentureBeat는 이를 “GPU 범용 시대의 종말”이라고 표현했다. 다소 과격한 표현이지만, 방향성은 맞다. 추론이 전체 AI 컴퓨트 비용의 2/3를 차지하는 세상에서, 추론 전용 하드웨어는 선택이 아니라 필수가 되어가고 있다.

물론 한계점도 있다. Groq LPU의 SRAM 기반 설계는 모델 크기에 물리적 제약이 따른다. 초거대 모델을 통째로 올리기 어렵다. 또한 NVIDIA가 Groq 기술을 자사 플랫폼에 완전히 통합하는 데는 시간이 걸릴 것이다. 2세대 LPX의 실제 양산·출하 일정도 아직 확정되지 않았다.

하드웨어만이 아니다. NVIDIA가 소프트웨어 생태계도 완전히 재편하고 있다.

소프트웨어 생태계 — NemoClaw, Isaac GR00T, Omniverse 업데이트¶

NemoClaw — Jensen Huang이 “역사상 가장 중요한 소프트웨어 릴리스”라고 부른 것¶

Jensen Huang은 과장을 잘 하지 않는다. (가죽 자켓은 좀 많이 입지만.) 그가 NemoClaw를 “역사상 가장 중요한 소프트웨어 릴리스”라고 표현한 건 주목할 만하다.

NemoClaw는 오픈소스 엔터프라이즈 AI 에이전트 플랫폼이다. 핵심 포인트는:

- 오픈소스: 코드를 공개한다. 벤더 종속(lock-in) 우려를 정면으로 돌파하는 전략이다.

- 하드웨어 무관(Hardware-agnostic): NVIDIA GPU 없이도 실행 가능하다. 이건 꽤 놀라운 결정이다. 자사 GPU 판매에 도움이 안 될 수 있으니까.

- 엔터프라이즈 보안 내장: 다층 보안, 내장 프라이버시 제어를 기본 탑재했다.

- 파트너 라인업: Salesforce, Cisco, Google, Adobe, CrowdStrike 등에 이미 피칭 진행 중

NVIDIA의 계산은 이렇다 — 에이전틱 AI의 생태계 표준을 장악하면, 결국 대규모 인프라가 필요한 고객은 NVIDIA 하드웨어로 돌아온다. 안드로이드를 오픈소스로 풀었던 Google의 전략과 유사하다.

기업 AI 담당자라면, NemoClaw가 정식 출시되면 우선 내부 PoC(Proof of Concept)를 돌려보는 걸 권한다. 에이전틱 AI는 아직 초기 시장이라 어떤 프레임워크가 표준이 될지 불확실하지만, NVIDIA의 인프라 생태계와 직접 연결된다는 점은 분명한 이점이다.

Isaac GR00T & 로보틱스 — AI에 물리적 몸을 주다¶

소프트웨어 AI에서 물리적 AI(Physical AI)로의 확장도 이번 GTC의 주요 테마다.

Isaac GR00T N1.6은 휴머노이드 로봇용 오픈 추론 VLA(Vision Language Action) 모델이다. 로봇이 눈(비전)으로 보고, 언어로 명령을 이해하고, 전신으로 행동하는 걸 통합 처리한다. Franka Robotics, NEURA Robotics 등이 이미 GR00T 워크플로를 활용 중이다.

특히 주목할 건 Hugging Face와의 연동이다. Isaac + GR00T 기술이 LeRobot 오픈소스 프레임워크에 통합되면서, 200만 로보틱스 개발자와 1,300만 AI 빌더가 로보틱스 개발에 접근할 수 있게 됐다. 로보틱스의 진입 장벽이 급격히 낮아지고 있다.

Omniverse 디지털 트윈 플랫폼도 확장된다. Cosmos 월드 파운데이션 모델과 연동해, 로봇과 자율주행 시스템을 물리적으로 제작하기 전에 가상 환경에서 충분히 테스트할 수 있다.

개발자가 지금 주목할 포인트¶

- CUDA 생태계는 건재하다 — Vera Rubin + Groq IP 통합이 이뤄져도 기존 CUDA 코드베이스의 가치는 유지된다. 새로운 최적화 경로가 추가되는 것이지, 기존 투자가 무효화되는 건 아니다.

- 추론 최적화가 핵심 역량 — NVFP4, 양자화, 배치 최적화 등 추론 기술이 앞으로 개발자 채용 시장에서 프리미엄을 받을 것이다.

- 에이전틱 AI 프레임워크 선점 — NemoClaw, LangChain, CrewAI 등 에이전트 프레임워크를 미리 탐색해두면, 시장이 폭발할 때 준비된 상태에서 시작할 수 있다.

소비자 시장도 빠지지 않았다. NVIDIA가 드디어 노트북 CPU 시장에 본격 진출한다.

N1/N1X — NVIDIA의 ARM 노트북 CPU, PC 시장의 판도 변화¶

N1, N1X 칩 개요¶

NVIDIA가 GPU만 만드는 회사라고 생각했다면, 이제 그 인식을 수정해야 한다.

N1은 일반 소비자용, N1X는 게이밍·고성능 특화 칩이다. 둘 다 ARM 기반이며, MediaTek과 협력해 TSMC 3nm 공정으로 제조한다. N1X의 주요 사양은:

- 20코어 ARM 프로세서

- 최대 128GB 통합 LPDDR5X 메모리

- Windows on ARM 지원 (Copilot+ PC 생태계)

Dell과 Lenovo가 2026년 상반기 출시를 예고했다. Lenovo Legion 7 같은 게이밍 라인업도 포함되어 있다. 후속작 N2 시리즈는 2027년 Q3 예정이며, 데스크톱 진출 가능성까지 거론되고 있다.

경쟁 구도¶

ARM 기반 Windows 노트북 시장은 이미 Qualcomm Snapdragon X Elite가 선점하고 있고, Apple M시리즈는 macOS 진영에서 독보적이다. Intel과 AMD는 x86 진영을 지키고 있다.

NVIDIA N1X의 핵심 차별점은 GPU 성능이다. NVIDIA가 수십 년간 쌓아온 GPU 기술력을 CPU+GPU 통합 칩에 녹여넣었다. 특히 x86 게이밍 에뮬레이션 성능이 경쟁사 대비 우수할 것으로 예상된다. ARM 기반 노트북에서 기존 x86 PC 게임을 얼마나 잘 돌릴 수 있느냐가 시장 성패를 가를 핵심 변수다.

솔직히 말하면, ARM 기반 Windows 노트북은 아직 소프트웨어 호환성이라는 넘어야 할 산이 있다. 전문 소프트웨어나 오래된 게임의 호환성은 시간이 지나야 검증될 것이다. 하지만 NVIDIA의 GPU 기술력과 Dell·Lenovo의 유통망이 결합되면, Qualcomm 독점이던 ARM Windows 시장에 의미 있는 변화가 생길 건 확실하다.

이 모든 하드웨어의 심장에는 한국 반도체 기업이 있다.

한국 반도체 기업에 미치는 영향 — 삼성전자, SK하이닉스의 HBM4 전쟁¶

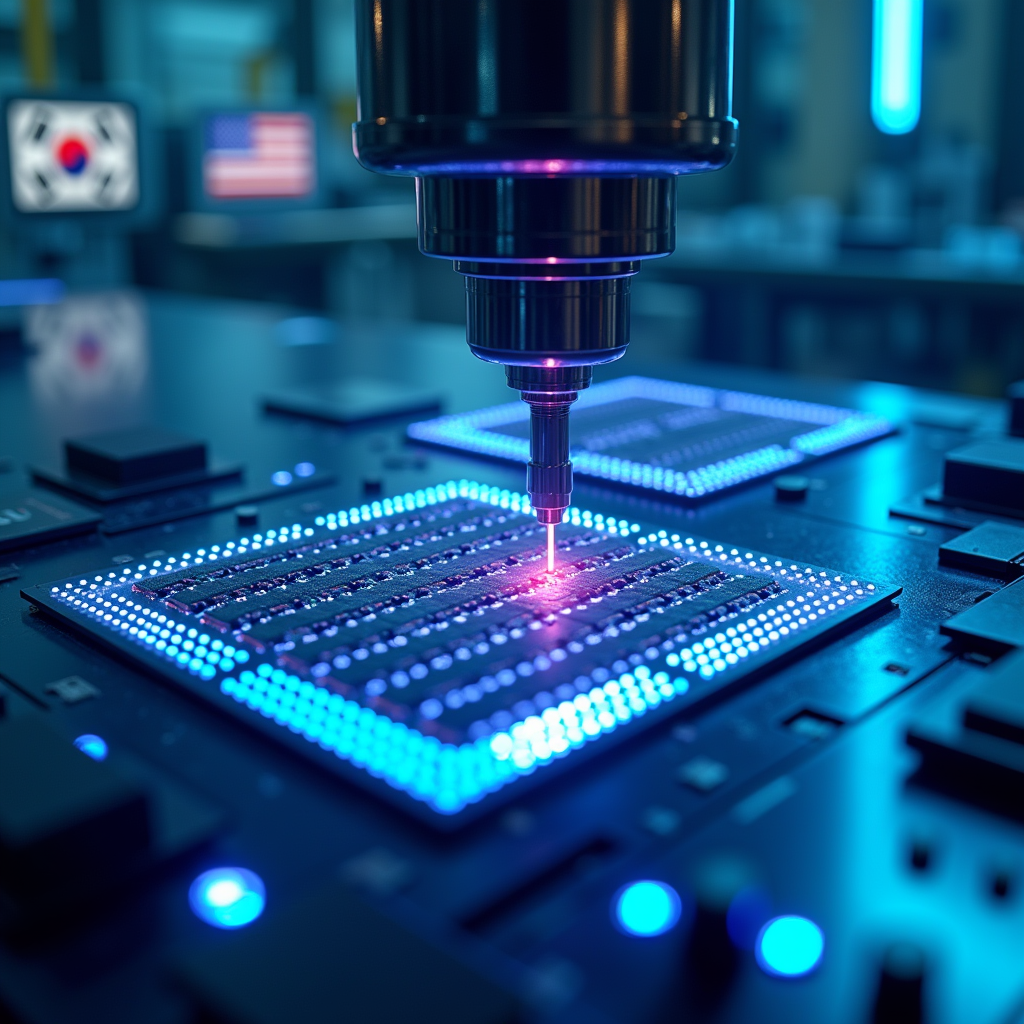

HBM4 공급 현황 — 삼성 vs SK하이닉스¶

Vera Rubin이 HBM4를 채택한다는 건, HBM4를 만들 수 있는 기업에게 엄청난 기회가 열린다는 뜻이다. 현재 HBM4 양산이 가능한 곳은 세계에서 두 곳뿐이다.

| 기업 | HBM4 현황 | 핵심 포인트 |

|---|---|---|

| 삼성전자 | 2026년 2월 12일 HBM4 양산 출하, Rubin GPU 탑재 확정 | SOCAMM2 절반 공급 확보 |

| SK하이닉스 | 16층 48GB HBM4, 11.7Gbps | LLM 효율성 중심 마케팅, 최태원 회장 GTC 최초 참석 |

| Micron | 탈락 | 삼성·SK하이닉스 양강 체제 확립 |

SK그룹 최태원 회장이 GTC에 처음 참석한다는 것 자체가 신호다. HBM 공급 확대를 직접 논의하기 위해서다. 삼성전자도 GTC에서 SOCAMM2 서버 메모리 모듈을 전시한다.

SOCAMM2 — 차세대 AI 서버 메모리의 새 시장¶

SOCAMM2는 LPDDR 기반의 서버 메모리 모듈로, 기존 DDR 대비 전력 소비 1/3 수준이다. Vera Rubin의 Vera CPU가 최대 1.5TB LPDDR5x를 사용하는데, 여기에 SOCAMM2 모듈이 들어간다.

삼성전자가 NVIDIA Rubin 양산에 필요한 SOCAMM2의 절반을 공급한다는 보도가 나왔다. HBM4뿐 아니라 SOCAMM2라는 새로운 시장까지 열리면서, 한국 메모리 기업에게는 이중 수혜 구조가 만들어지고 있다.

한국 AI 인프라 투자 — 이미 시작된 변화¶

한국의 AI 인프라 투자도 급속히 확대되고 있다.

| 주체 | AI 팩토리 규모 |

|---|---|

| 한국 정부 (소버린 AI) | 50,000+ GPU |

| 삼성전자 | 50,000+ GPU |

| SK그룹 | 50,000+ NVIDIA GPU |

| 현대자동차그룹 | 50,000 Blackwell GPU |

각 50,000 GPU 이상이면 상당한 규모의 AI 팩토리다. 현대자동차는 자율주행과 로보틱스, 삼성과 SK는 AI 서비스와 메모리 최적화에 활용할 것으로 보인다.

투자 시사점 — 냉정하게 볼 점¶

GTC 발표 후 한국 반도체 주가가 단기 급등하는 패턴은 과거에도 반복됐다. 하지만 몇 가지 리스크 요인도 냉정하게 짚어야 한다:

- 수요 변동성: AI 투자의 성장률이 둔화(NVIDIA 기준 전년 122%에서 65%로)되고 있다. 절대 규모는 역대 최대지만, 성장률 둔화는 언제든 밸류에이션 조정으로 이어질 수 있다.

- 기술 난이도: HBM4는 HBM3e 대비 대역폭이 2.8배 향상되지만, 그만큼 제조 난이도와 불량률 리스크도 높아진다.

- 멀티벤더 추세: OpenAI가 AMD에 약 10% 지분 투자를 한 것처럼, 주요 고객사가 단일 벤더 종속을 회피하는 추세다. NVIDIA 의존도만으로 한국 반도체 기업의 실적을 예단하기 어렵다.

또 하나 놓치기 쉬운 포인트 — AMD CEO 리사 수가 GTC 기간인 3월 18일에 삼성전자·네이버 경영진과 면담을 예정하고 있다. AMD MI400(432GB HBM4)의 한국 기업 공급 논의일 가능성이 높다. 한국 메모리 기업 입장에서는 NVIDIA뿐 아니라 AMD 수주까지 기대할 수 있는 상황이다.

마지막으로, 이 모든 것이 2026~2028년 AI 산업 지형을 어떻게 바꾸는지 정리한다.

2026~2028 NVIDIA 로드맵 타임라인과 시사점¶

전체 로드맵 한눈에 보기¶

| 시기 | 하드웨어 | 소프트웨어/플랫폼 | 비고 |

|---|---|---|---|

| 2026 상반기 | Vera Rubin 풀 프로덕션, N1/N1X 출시 | NemoClaw 오픈소스 공개 | LPX 1세대 운영 시작 |

| 2026 하반기 | Vera Rubin 파트너 공급, LPX 2세대 (256 LPU) | Isaac GR00T N1.6 확산 | HBM4 본격 수요 |

| 2027 | Rubin Ultra, N2 시리즈 | 에이전틱 AI 생태계 성숙 | SOCAMM2 시장 확대 |

| 2028+ | Feynman 아키텍처 (TSMC A16 1.6nm, 실리콘 포토닉스) | — | 1,000W+ TDP 예상 |

Feynman 아키텍처가 특히 흥미로운데, 실리콘 포토닉스를 적용할 가능성이 거론되고 있다. 전기 신호 대신 빛으로 칩 간 통신을 하는 기술로, 대역폭과 에너지 효율에서 근본적인 도약이 가능하다. 아직 예비 단계지만, NVIDIA가 Feynman에 SRAM 대규모 통합과 3D 적층까지 조합한다면, 2028년은 또 한 번의 게임 체인저가 될 수 있다.

AI 산업 전체에 던지는 메시지¶

이번 GTC에서 읽을 수 있는 큰 그림은 세 가지다.

첫째, “추론 시대”의 공식 개막. 학습 인프라에서 추론 인프라로 투자 무게 중심이 이동하고 있다. Groq 200억 달러 딜, LPX 랙, 토큰당 비용 10배 절감 — 모두 추론을 향한 베팅이다.

둘째, 에이전틱 AI가 차세대 컴퓨팅 패러다임. NemoClaw, Vera CPU의 에이전트 최적화 설계, 로보틱스 플랫폼 확장까지. NVIDIA는 AI가 “질문에 답하는 도구”에서 “스스로 판단하고 행동하는 에이전트”로 진화하는 데 전사적으로 베팅하고 있다.

셋째, 풀스택 전략의 완성. 칩(Vera Rubin + LPU) → 시스템(NVL72 + LPX) → 소프트웨어(NemoClaw, CUDA) → 플랫폼(Omniverse, Isaac) → 생태계(오픈소스, 파트너십). NVIDIA는 AI 인프라의 모든 층을 장악하려 하고 있다.

경쟁 구도 — NVIDIA만의 무대는 아니다¶

공정하게 말하자면, 경쟁도 거세지고 있다.

| 회사 | 핵심 제품 | 강점 | 약점 |

|---|---|---|---|

| NVIDIA | Vera Rubin + LPX | CUDA 생태계, 풀스택, Groq IP | 높은 가격, 전력 소비 |

| AMD | Instinct MI400 (432GB HBM4) | 메모리 용량 우위, OpenAI 투자 유치 | 소프트웨어 생태계 격차 |

| Ironwood TPU (7세대) | 추론 특화 설계, 9,216칩 슈퍼팟 | 자체 클라우드 전용 | |

| Intel | Crescent Island | 추론 전용 차별화 | 2026년 말 샘플링, 시장 진입 늦음 |

AMD MI400은 HBM4 432GB로 Vera Rubin의 288GB보다 메모리가 많다. 대형 모델을 통째로 올리는 데는 유리할 수 있다. Google Ironwood TPU는 추론 특화 설계로 와트당 성능이 이전 세대 대비 2배이며, 슈퍼팟당 최대 9,216칩까지 확장된다. Intel은 아직 갈 길이 멀지만, 추론 전용이라는 명확한 포지셔닝을 잡았다.

AI 가속기 시장 자체가 2024년 1,160억 달러에서 2033년 6,040억 달러(CAGR 16%)로 성장할 전망이니, 한 회사가 독식하기보다는 여러 플레이어가 각자의 포지션을 확보하는 구도가 될 가능성이 높다.

실무자가 지금 준비해야 할 3가지¶

- 추론 최적화 기술 스택 학습 — NVFP4 양자화, LPU/GPU 하이브리드 배치 전략, 배치 스케줄링 등. 추론 비용 최적화가 앞으로 실무에서 가장 뜨거운 주제가 될 것이다.

- 에이전틱 AI 프레임워크 사전 탐색 — NemoClaw가 오픈소스로 공개되면 바로 테스트할 수 있도록 준비. LangChain, CrewAI 등 기존 프레임워크와의 비교 분석도 미리 해두면 좋다.

- HBM4/SOCAMM2 기반 인프라 스펙 변화 모니터링 — 클라우드 서비스 업체의 Vera Rubin 인스턴스 제공 시기, 가격 정책 등을 추적해야 한다. 자체 인프라를 운영하는 기업이라면 전력 계획까지 다시 검토해야 할 수 있다.

마무리 — GTC 2026 한 줄 정리와 시청 가이드¶

TL;DR — 핵심만 빠르게¶

- Vera Rubin: 추론 성능 5배, 토큰당 비용 1/10. Blackwell 이후 가장 큰 세대 도약.

- Groq 추론칩: GPU와 완전히 다른 SRAM 기반 결정론적 아키텍처. 200억 달러짜리 베팅.

- NemoClaw: 엔터프라이즈 AI 에이전트의 표준 플랫폼을 노리는 오픈소스 전략.

- N1/N1X: PC 시장까지 넘보는 NVIDIA의 ARM CPU. Dell·Lenovo에서 올해 출시.

- 한국 반도체: 삼성·SK하이닉스 HBM4 양강 체제 확립. SOCAMM2라는 신시장까지 보너스.

- 큰 그림: 학습에서 추론으로, 범용 GPU에서 워크로드별 최적화로, AI 도구에서 AI 에이전트로 — 세 가지 전환이 동시에 일어나고 있다.

키노트 시청 방법¶

| 항목 | 내용 |

|---|---|

| 한국시간 | 2026년 3월 17일(화) 오전 3시 |

| 채널 | nvidia.com/gtc/keynote 또는 YouTube |

| 비용 | 무료 |

| 추천 | 새벽 시청이 어려우면 당일 오전 리플레이로. 핵심 내용은 이 글에서 발표 후 업데이트 예정. |

새벽 3시에 일어나기 어려운 분들을 위해, 키노트 발표 후 이 글을 실제 발표 내용 기반으로 업데이트할 예정이다. 북마크 해두시면 된다.

이 글은 GTC 2026 개막 전날(2026년 3월 15일) 기준으로 작성되었습니다. 키노트 및 주요 세션 발표 후 실제 내용을 반영하여 업데이트됩니다.